情報機器(PC/スマホ/IoTデバイスなど)のハード/ソフト/使い方が、大転換期です。原因は、生成AI革命。インターネット商用解放期に匹敵する気がします。

2024年も半分終わった今、見えてきた情報機器大転換期の現状をまとめました。1章と2章が、ソフトバンクの生成AI革命の考え方、3章以降が、現状という段取りです。

ソフトバンクのAIとAGI、ASI

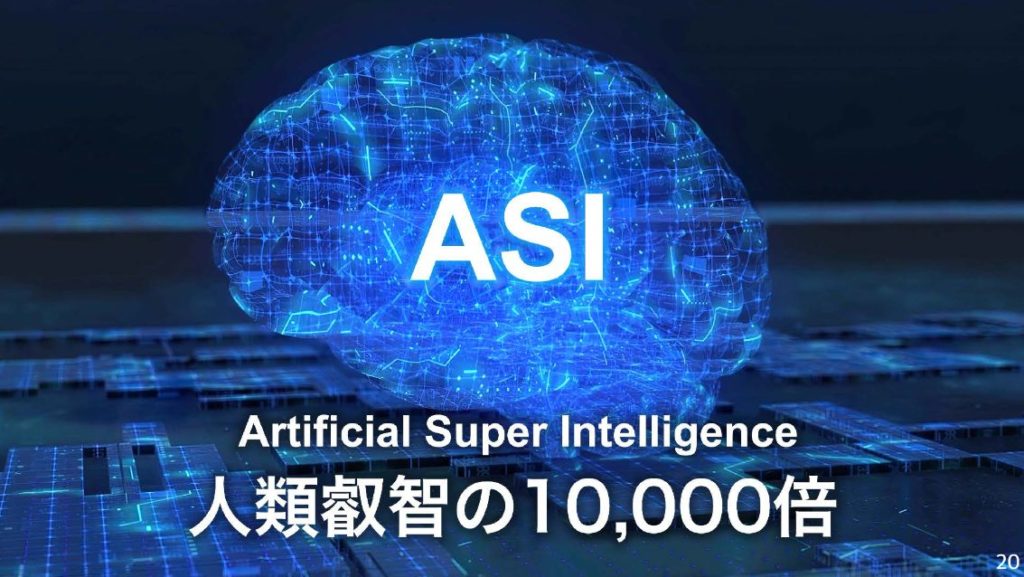

人類叡智の10000倍能力のArtificial Super Intelligence(出典:記事) ソフトバンク会長兼社長の孫正義氏が、2024年6月21日の定時株主総会で、ソフトバンクは、ASI(Artificial Super Intelligence)を実現するとASCII記事 が掲載しました。記事を極簡単にまとめたのが本章と次章です。

AGI(Artificial General Intelligence=汎用人工知能)とは、人間の持つ考え方、知識の「一部を機能化」した現在のAIの親玉に相当し、人間と同じか最大でも10倍程度上回る「汎用の人工知能」。先端AI研究者のテーマがこのAGIで、5年以内、場合によれば3年ぐらいでAGI時代となる。

様々な天才同士が刺激しあい進化した人類と同様、AGI同士が刺激しあい、人類進化を加速するのがASI時代。ASIは10年前後でやってくる。孫氏が決めた指標では、人間の「1万倍程度の英知」。人類20万年史上、初めて圧倒的な人口知能となり、全常識が変わるのがASI時代。

例えば、スマートロボットがASIにつながると、工場生産や道路掃除、買い物や洗濯も代行可能。自動運転も、AIが技能学習し、一度も行ったことが無い場所でもスイスイ自動運転でき、大量生産や加工、物流などはロボットに置き換わる。

ソフトバンク孫正義氏が生まれた理由・使命は、このASI実現 。

ASI実現手段

ソフトバンクグループ総力でASI推進(出典:記事) 孫氏は、更にASI時代の基盤技術の1つが、現在様々な情報機器へ半導体IP提供中のArmとしました(Arm株式9割近くをソフトバンクが保有中)。

Armの強みは、設計力と低消費電力稼働 で、ASIの広がりに貢献。出荷数量は上がることはあっても、下がることはない。ASI実現のため、ソフトバンクグループ総力でArm AIチップ、AIデータセンタ、AIロボットへ取組む。

Armの将来を孫氏は信じている。

制御系ハードウェア転換

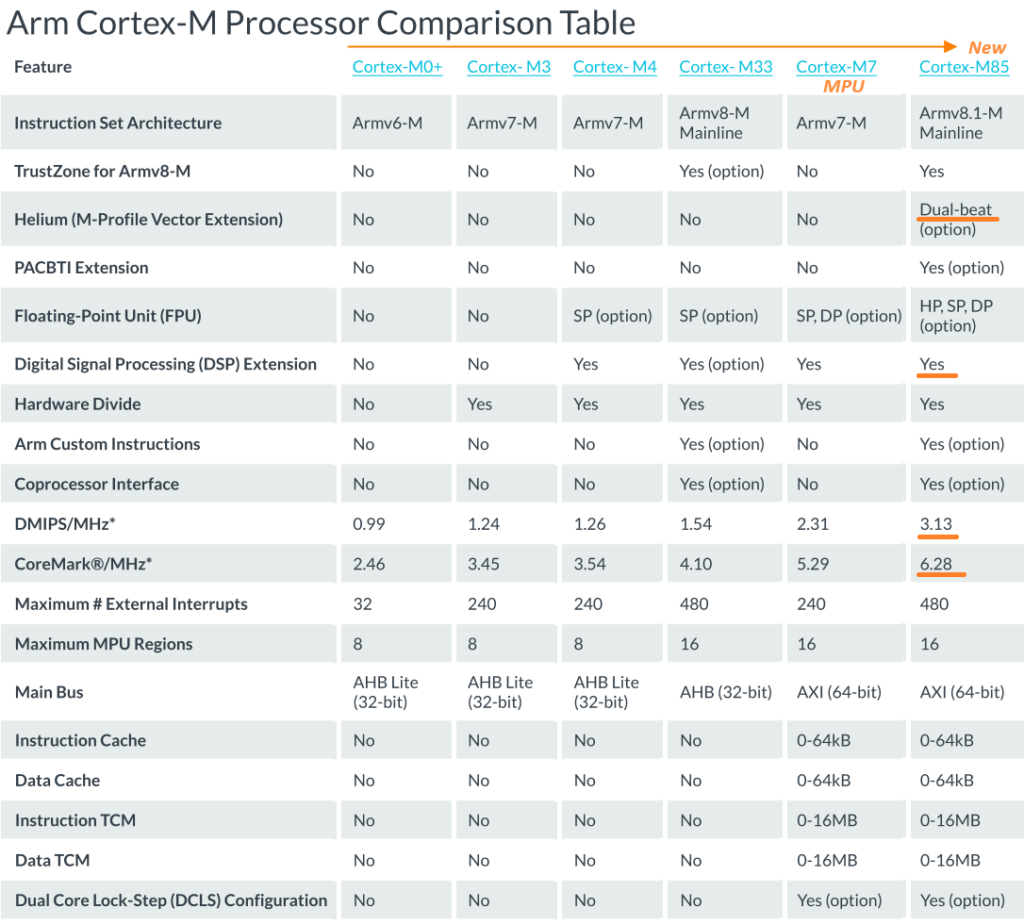

Arm IPコアは、本ブログ掲載Cortex-Mシリーズをはじめ、多くのMCUベンダハードウェアにも採用中です。MCUのエッジAI化に伴い、従来シリーズよりも更に高性能なCortex-Mコア:Cortex-M85 搭載MCUも発売開始となりました。

Cortex-M85特性比較(出典:ARM) PCは、Microsoft Copilot+ PCが2024年6月18日にワールドローンチされました。40TOPS以上のNPUが注目され勝ちですが、NPUを制御するCPUにも転換が起こりつつあります。

現在、Copilot+ PC要件を満たすCPUは、QualcommのSnapdragon X Eliteだけです。このCPUも、Arm IPコアを採用中 (4章)です。他社に先駆けるArm設計力が表れています。

AI処理でPCよりも先行するAIスマホは、そのCPUの多くがArmライセンスのチップです。6月20日発表のAppleパーソナルAI Intelligenceハードウェア要件 は、A17 ProチップとMシリーズです。iPhone 15/15 Plus非対応のため、90%以上のiPhoneユーザは、Apple Intelligenceを使えないそうです。

これら制御系ハードウェアの転換理由は、「AI処理を実用可能なレベルで高速実行するには、ハードウェアが肝心」 だからです。

つまり、生成AI革命が、従来制御系の全ハードウェアを転換させつつあるのが、今です。

ソフトウェア転換

NPUなどのAI処理ハードウェアを活かすのは、ソフトウェアです。例えば、Copilot+ PC には、Recall、Cocreator、Live Captions、Windows Studio EffectなどのAI機能が標準で備わっています。

但し更に重要な点は、これら標準AI機能の基となるWindows Copilot Runtimeを活用し、新なAIソフトウェアが開発できること、しかもArmネイティブ であることです。

※Armネイティブとは、汎用RuntimeがArm専用ライブラリのように無駄無く高速動作すること。

MacOSは、Arm化が進んでいます。Windowsソフトウェア開発も、下図が示す従来x86からArmネイティブソフトウェア転換を迎えているようです(詳細はコチラ の記事参照)。

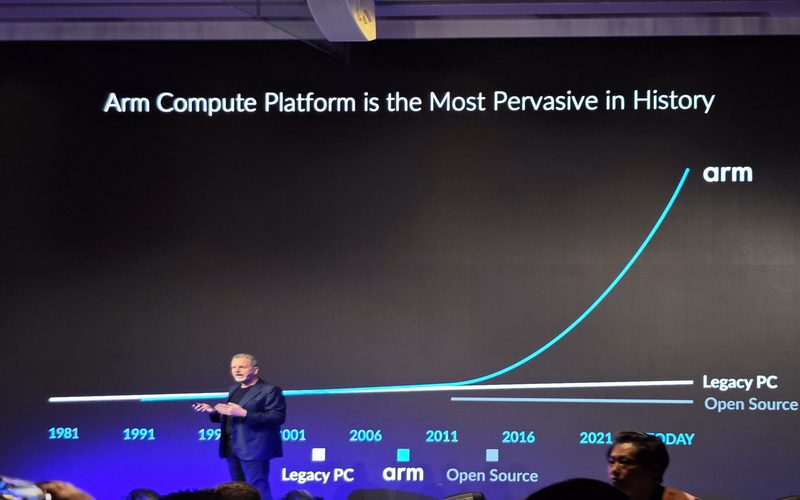

ArmはレガシーのPC(x86など)を大きく上回っているとアピール(出典:記事) 情報機器使い方転換

インターネット商用解放は、IT革命 をもたらしました。ユーザは、PCやスマホなどの機器を使って、ネット上を検索し、情報を得るようになりました。ネットに溢れる情報の検索装置 が、IT機器でした。

生成AI革命は、PCやスマホの使い方を、単なる検索装置からアシスタント代行へと転換させつつあります。つまり、より高度な情報解析 や解析に基づいた提案 ができる個人アシスタントとしての使い方です。

従来の情報機器を、人間的で簡単に使えるAIアシスタント化 しつつあるのが、今です。

Summary:情報機器大転換期

クラウド・エッジ全基盤を提供するArm IP(出典:記事) 生成AI革命でPC/スマホ/IoTデバイスなどの情報機器ハードウェア/ソフトウェア/使い方が、大きく転換しつつある2024年半分終了の今をまとめました。

制御系IP提供のArm株式9割保有中ソフトバンクの生成AI革命に対する考え方と、AI実用はハードウェアが肝心、ソフトウェアのArmネイティブ化、情報機器AIアシスタント化などの転換現状を示しました。

AI進化スピードは驚異的です。人間開発者も進化が必要です。現状マクロ把握のため本稿を作成しました。

Afterword:オープンソースハードウェアコア、RISC-V

Cortex-M代替として急浮上のRISC-V ライセンス料が必要なArm IPコアの対極にあるのが、オープンソースハードウェアコアです。例えば、RISC-V 。採用例は、ルネサスのRISC-V MCU/MPU や、EsperantoのAIチップ に見られます。

RISC-V採用理由は、少数命令による低消費電力動作です。Arm同様、低電力動作ハードウェアの重要性が解ります。RISC-VかArmかのコア選択は、製品売上見込みとその投資額で決まると思います。

※MCU製品は、IPハードウェア以外にコンパイラ、デバッガなどソフトウェア開発ツールも必要。Armコアならツール入手も容易だが、オープンソースハードウェアコアはこれらもベンダ準備必要(関連投稿はコチラ )。

日本政府マイナンバーカード施策に、上記のような費用対効果検討が全く無いのは、原資が税金のため?😢